D2L-13-Softmax_Regression

# Softmax 回归

2022-02-11

Tags: #SoftmaxRegression #MachineLearning #Classification #MulticlassClassification

- Softmax回归解决的是多分类问题1, 它可以看作是二分类的 Logistic_Regression的推广.

# Softmax回归

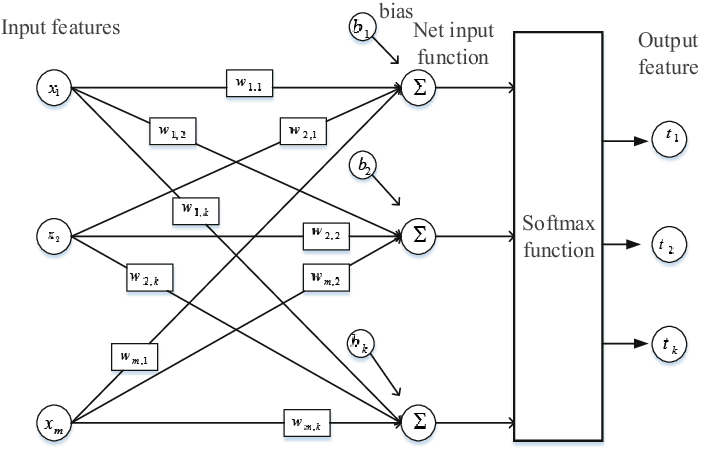

- Softmax回归就是在线性回归的基础上套上一个Softmax函数, 取输出结果中概率最大的项作为预测结果.

# 交叉熵作为损失函数

# Softmax and Argmax

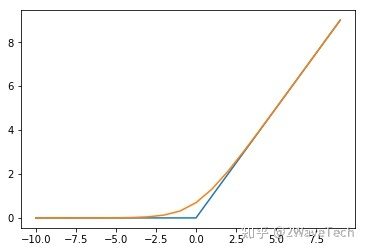

- 不像Softmax输出K个概率值, Argmax函数直接将输入向量里面最大的元素设置为1, 其他均置为0.

- Argmax常常用于输出预测结果, 但是Argmax有个很严重的缺点: 它的结果没法用于反向传播优化参数: (因为它要么不可导要么导数为0)

解释:

# Softmax名称的由来

Softmax的名字是怎么来的? - 2WaveTech的文章 - 知乎 https://zhuanlan.zhihu.com/p/58859958

Softmax是"Hardmax"函数的Soft版本:

# 与Logistic(Sigmoid)回归的联系

Relation_between_Softmax_and_Logistic_Regression

# 数值稳定性上面的一些细节

softmax和cross-entropy是什么关系? - 董鑫的回答 - 知乎 https://www.zhihu.com/question/294679135/answer/885285177

和Logistic回归一样, 虽然它名字叫回归, 实际上解决的却是分类问题. 为什么呢? 搜索了一会儿没有得到结果😥 ↩︎